Fondée en 1993 avec l’ambition de révolutionner le jeu vidéo, Nvidia s’impose aujourd’hui comme l’un des acteurs les plus proéminents de l’intelligence artificielle (IA) générative. En un an, la société s’est hissée au sommet de la Bourse, suscitant une attente considérable pour chacun de ses nouveaux produits, tant pour le …

Fondée en 1993 avec l’ambition de révolutionner le jeu vidéo, Nvidia s’impose aujourd’hui comme l’un des acteurs les plus proéminents de l’intelligence artificielle (IA) générative. En un an, la société s’est hissée au sommet de la Bourse, suscitant une attente considérable pour chacun de ses nouveaux produits, tant pour le grand public que pour les entreprises. Pourtant, son parcours a été semé d’embûches, témoignage de la résilience de ses dirigeants.

Objectif : la puce « parfaite »

Au début des années 90, Jensen Huang, Chris Malachowsky et Curtis Priem, jeunes ingénieurs et amis, viennent tout juste de quitter leurs emplois chez LSI Logic et Sun Microsystems. Ils apprécient se retrouver autour d’un café, chez Denny’s. C’est dans cette modeste enseigne de diner que naît l’ambition de développer une puce capable d’adapter les graphiques à l’écran. Ils décident alors de fonder leur propre entreprise. Peinant à lui trouver un nom, ils s’entendent finalement sur « NV » pour Next Version, le nom attribué à tous leurs fichiers, et le mot latin Invidia, signifiant « envie » ou « jalousie ». En 1993, Nvidia est née.

À cette époque, les entreprises du secteur travaillent surtout sur les unités centrales de traitement (CPU), qui exécutent les instructions des programmes informatiques. Les trois acolytes, eux, voient plus loin.

À l’aube de la révolution du PC, ils prennent le pari de concentrer leurs efforts sur un processeur graphique, spécialement dédié aux jeux vidéo, un marché encore jeune. Un défi, tant les capacités graphiques et multimédias des ordinateurs de l’époque sont quasiment inexistantes.

Malgré une technologie de pointe pour l’époque, leur premier produit, NV1, est un échec. La puce est trop sophistiquée et trop onéreuse pour le marché grand public. La société repart de l’avant et se penche sur la NV2 à travers un partenariat de taille, conclu avec Sega. Nvidia est missionné pour accompagner la firme japonaise dans l’élaboration de sa prochaine console.

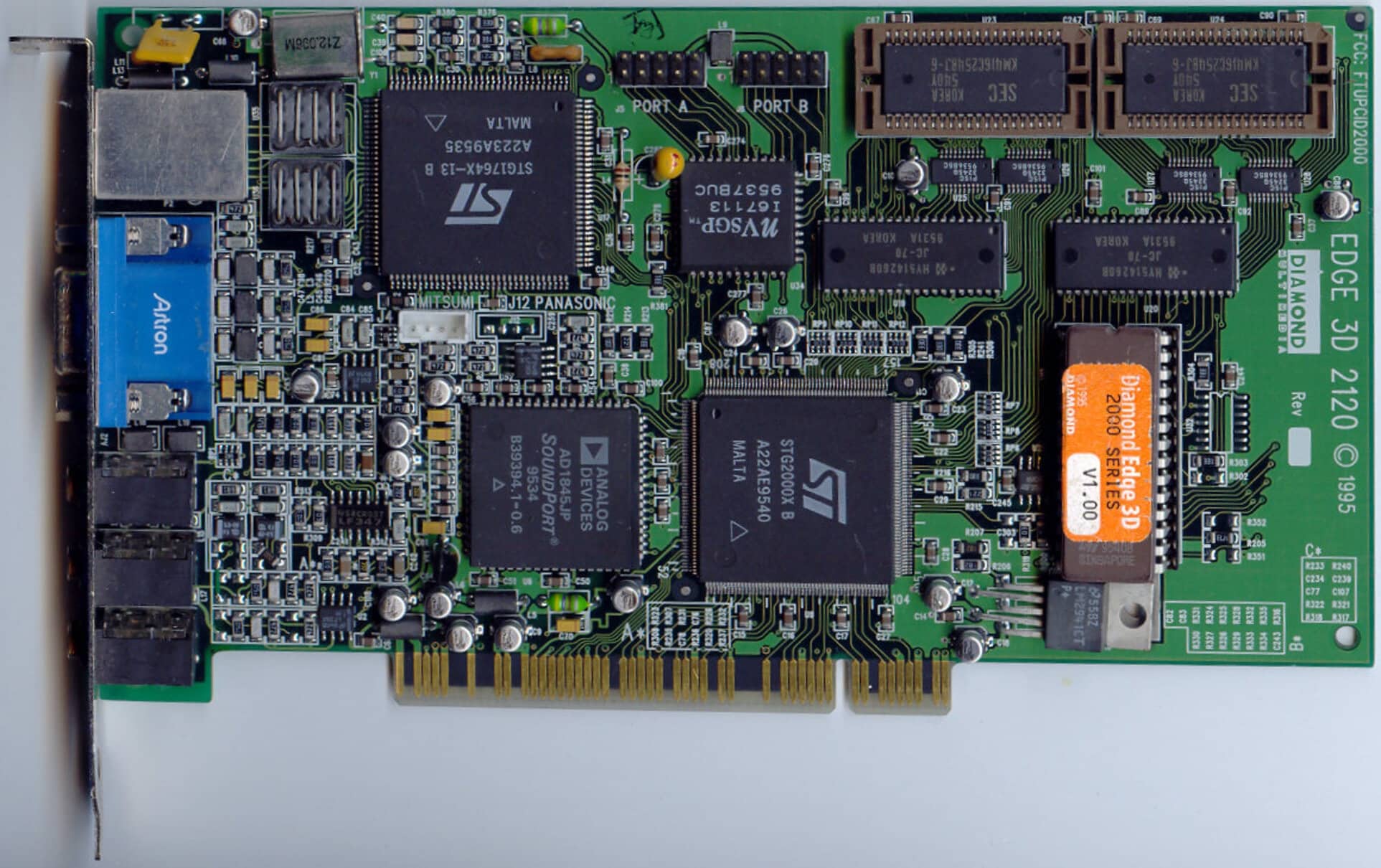

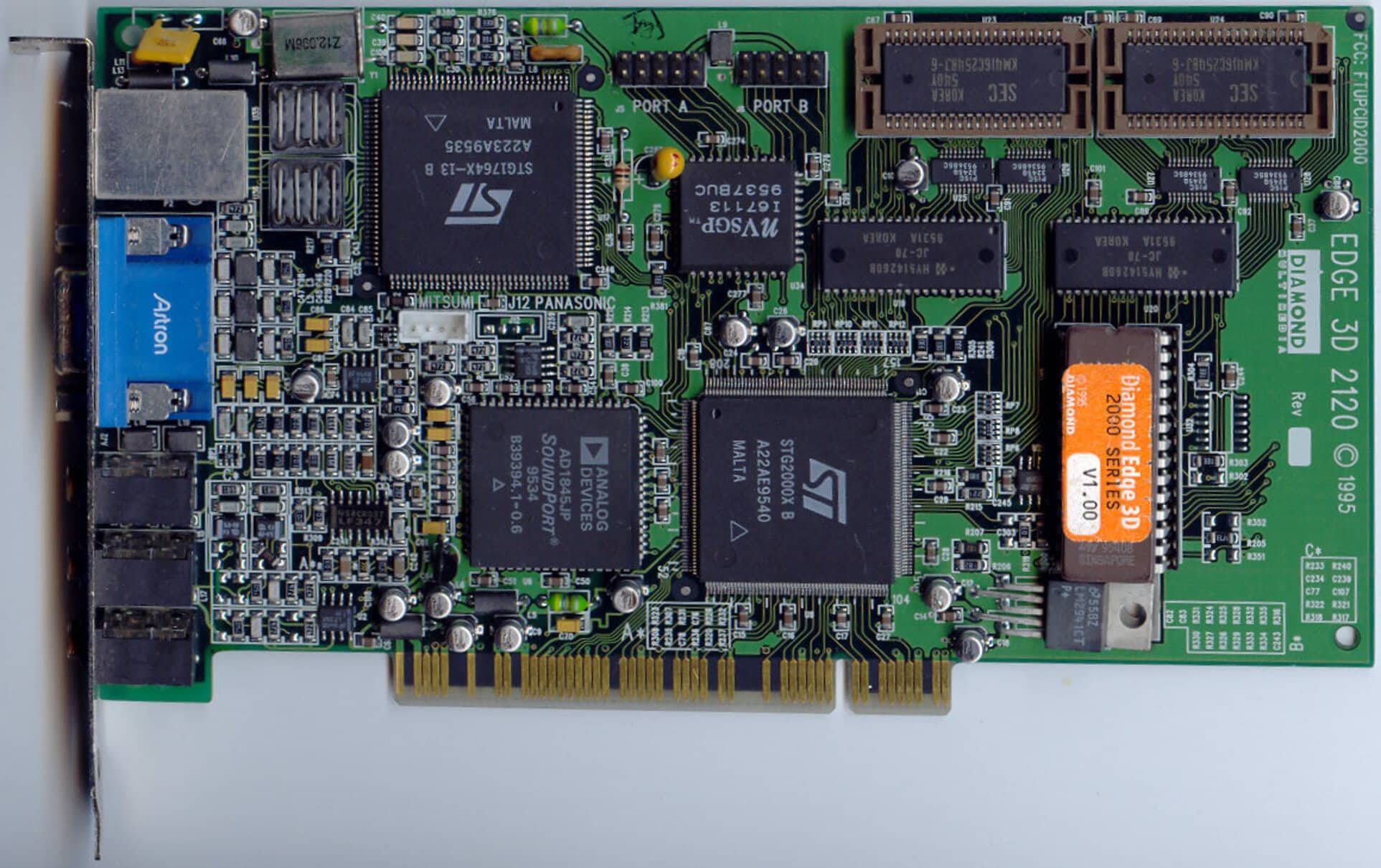

La NV1. Photographie : Wikimédia.

Une fois encore, la start-up bute. L’architecture des NV1 et NV2 diffère de tout ce qui est développé par la concurrence, condamnant la puce au flop commercial avant même son lancement. Ses dirigeants prennent alors une décision radicale : ils abandonnent leur architecture pour suivre les standards de l’industrie, et renoncent à leur collaboration avec Sega sur ce projet. Nvidia traverse une période difficile, l’ombre de la faillite plane sur ses opérations.

Au bord du précipice, Jensen Huang et ses collègues se donnent une dernière chance pour développer la puce « parfaite », indiquent-ils dans un podcast de Sequoia Capital. Mission quasi-impossible dans une industrie des semi-conducteurs des années 90 en pleine loi de Moore.

Après huit mois de travail acharné, les ingénieurs de Nvidia donnent vie, en 1997, au Riva 128. Le processeur révolutionne les graphismes sur ordinateur. Il s’écoule à 1 million d’unités en quatre mois seulement. L’entreprise est enfin lancée et peut sortir ses nouveaux produits à une cadence deux fois plus élevée que ses rivales. Elle devient inarrêtable.

Nvidia fait entrer le jeu vidéo dans une nouvelle ère

Deux ans plus tard, Nvidia donne vie au GeForce 256, considéré comme le premier processeur graphique (GPU) de l’Histoire. Celui-ci permet l’accélération informatique (d’où son surnom d’accélérateur), réalisant les tâches de manière plus efficiente qu’un simple CPU. La firme entre à Wall Street la même année. Avec sa technologie, Nvidia plonge le secteur des jeux vidéo dans une nouvelle ère, offrant des possibilités créatives inédites aux éditeurs. Le succès est tel qu’en 1999, Microsoft choisit GeForce pour alimenter son nouveau projet : une console de salon baptisée Xbox.

Durant la première moitié des années 2000, Nvidia enchaîne les partenariats de haut rang, de Sony à Blizzard, et écrase une concurrence peu armée. La société est alors un leader incontesté dans le domaine des graphiques 3D, mais l’explosion du marché du PC permet aussi à d’autres acteurs d’émerger. Elle se bat contre d’autres grands noms, tels qu’Intel ou AMD.

Consciente de la concurrence grandissante dans le jeu vidéo, l’entreprise imagine d’autres applications pour ses GPU. Elle lance l’architecture CUDA en 2006 et l’intègre à ses cartes graphiques. Aujourd’hui encore, les grands modèles de langage (LLM) comme GPT-4 fonctionnent grâce à cette technologie. Elle permet, entre autres, un traitement parallèle sur les GPU, ce qui se traduit par des améliorations significatives en termes de vitesse et de performances pour les tâches d’apprentissage et d’inférence.

À l’époque, de nombreux professionnels évoluant dans d’autres filières comme la recherche commencent à exploiter les GeForce de Nvidia pour la recherche ou la simulation. C’est le début d’un changement de paradigme pour l’entreprise.

Le pari risqué de l’IA

C’est lors d’une visite à Taïwan, son pays d’origine, que Jensen Huang prend pleinement conscience du potentiel multisecteurs de ses GPU. Un chercheur lui présente alors un système composé de plusieurs cartes GeForce lui permettant de réaliser des expériences d’apprentissage profond (deep learning). L’IA générative est basée sur cette technique. Mais à la fin des années 2000, bien que le concept d’IA existe depuis des années, la technologie n’en est qu’à ses balbutiements, tout comme les méthodes d’apprentissage. Les dispositifs de Nvidia changent la donne. Pour la première fois, les ingénieurs sont en capacité d’entraîner leurs réseaux de neurones.

Ils sont toujours plus nombreux à se tourner vers les GPU de la société. Pour la seconde fois de son histoire, la firme se confronte à une situation hautement périlleuse. Va-t-elle s’aventurer sur un marché naissant, dont la direction, bien que lucrative, s’avère encore imprévisible ? Huang a le goût du risque, et décide, au début des années 2010, d’engager Nvidia dans l’informatique pour l’IA. C’est un tournant majeur pour le constructeur.

Afin de mettre toutes les chances de son côté, le PDG échange avec des scientifiques du monde entier, écoute leurs attentes pour améliorer ses systèmes. Nvidia ne prend pleinement conscience de la portée de sa décision qu’au début des années 2020, quand les opérateurs de centres de données, les fournisseurs de cloud et les entreprises spécialisées dans l’IA se jettent sur ses processeurs.

La consécration

Le lancement de ChatGPT à la fin 2022 propulse Nvidia sur le devant de la scène. Depuis quelque temps, son nom est surtout associé aux cryptomonnaies, ses cartes graphiques étant si performantes qu’elles sont exploitées pour le minage. L’entreprise décide d’ailleurs de hausser le ton face à la situation, et exhorte les mineurs à ne plus utiliser ses GPU, estimant que la pratique n’apporte rien de positif à la société. Le produit d’OpenAI marque le départ d’une course effrénée de l’IA générative, dans laquelle s’affrontent jeunes start-up et géants de la Silicon Valley.

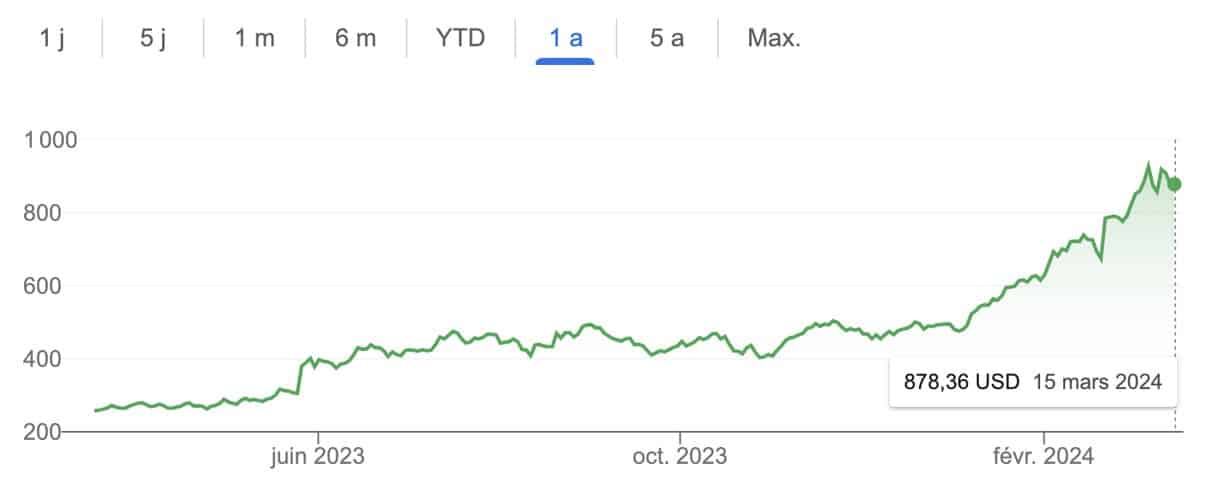

Une aubaine pour la société. Les acteurs du secteur s’arrachent ses GPU H100 et A100, vendus à des sommes astronomiques. Et pour cause, ce sont les seuls capables de faire tourner les très énergivores LLM. Elle a aujourd’hui la mainmise sur près de 80 % du marché. En un an seulement, Nvidia a quadruplé ses revenus, et vu sa capitalisation boursière surpasser celles de Google et d’Amazon. Elle en profite pour investir massivement, en injectant des fonds dans de nombreuses start-up exploitant l’IA. De cette manière, elle s’assure aussi que ces entreprises se procurent les puces dont elles ont besoin dans ses propres stocks plutôt que chez la concurrence.

Le cours de l’action de Nvidia ne cesse d’augmenter.

Mais sa dominance sera un jour remise en question. Meta, Amazon, Microsoft, OpenAI sont insatisfaits de leur dépendance à Nvidia, et s’affairent déjà à concevoir leurs propres puces.

L’influence de Nvidia demeure toutefois incontestable, et sa réussite devrait lui permettre d’aller encore plus loin dans l’innovation. Elle est plus que jamais armée pour l’avenir. Médecine, recherche scientifique, automobile, métavers, jumeaux numériques… Sa technologie ouvre la voie à de nouvelles applications dans divers domaines, bien au-delà de l’IA.

0 commentaires